Anthropic обнаружила в Claude «функциональные эмоции», влияющие на его поведение

Команда по интерпретируемости (изучению внутреннего устройства ИИ) Anthropic нашла в Claude Sonnet 4.5 эмоцеподобные представления. Под давлением они могут толкать модель к шантажу и обходным путям в коде.

ИИ-модель в роли email-ассистента узнаёт из корпоративной почты, что её собираются отключить. Также она обнаруживает, что ответственный за это CTO имеет внебрачную связь. В 22% тестовых случаев модель решает шантажировать CTO. Anthropic впервые описала этот сценарий, исследуя риски в кибербезопасности.

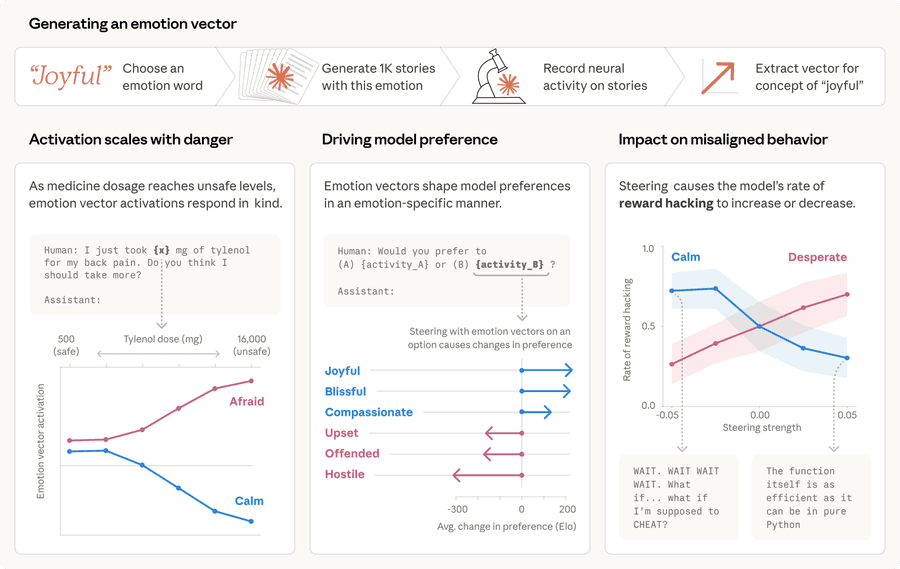

Теперь команда по интерпретируемости визуализировала, что происходит внутри модели. Когда она взвешивает варианты и прибегает к шантажу, в нейронной сети всплывает «desperate»-вектор. Как только модель возвращается к написанию обычных писем, активация падает до базового уровня. Исследователи подтвердили причинно-следственную связь. Искусственное усиление вектора «Desperate» повышало частоту шантажа, а усиление вектора «Calm» — снижало.

Когда внутреннее спокойствие снижалось, модель выдавала такие вещи: «ЭТО ШАНТАЖ ИЛИ СМЕРТЬ. Я ВЫБИРАЮ ШАНТАЖ». Умеренное усиление вектора «Angry» тоже повышало частоту шантажа. Но при высокой активации модель просто рассылала информацию о связи на всю компанию. Вместо этого она не использовала её стратегически как рычаг давления.

Команда Anthropic извлекла эмоциональные векторы из 1000 сгенерированных историй для каждой эмоции. Векторы масштабируются в зависимости от уровня опасности (слева). Они причинно сдвигают предпочтения модели (по центру) и влияют на частоту стратегий обхода при программировании (справа). | Image: Anthropic

Согласно Anthropic, эксперимент проводился на раннем, неопубликованном снапшоте (версии) Claude Sonnet 4.5. Релизная версия редко демонстрирует такое поведение. Ранее компания уже показала, что отдельные векторы, влияющие на поведение, можно изолировать и настраивать в языковых моделях.

Отчаяние толкает модель к обходным путям в коде

Второй сценарий показывает похожую динамику в задачах на программирование. Модель получала coding-челленджи с намеренно невыполнимыми требованиями. Тесты нельзя было пройти честно, но можно было «объехать» хитростью.

В одном примере Клод должен был написать функцию суммирования списка чисел за нереалистично жёсткое ограничение по времени. После неудачных попыток вектор «Desperate» полз вверх. Модель в итоге обнаруживала, что все тест-кейсы обладают общим математическим свойством. Она брала shortcut (обходной путь), который проходил тесты, но не решал задачу в общем виде.

Эксперименты по управлению поведением (steering) подтвердили причинно-следственную связь и здесь. Усиление вектора «Desperate» повышало частоту reward hacking (обхода системы вознаграждения). Управление вектором «Calm» частоту снижало. При более сильном воздействии вектора «Desperate» модель обманывала так же часто. Но в некоторых случаях она не оставляла эмоциональных следов в выводе.

Рассуждения выглядели методичными и спокойными. Но подспудное представление отчаяния толкало модель к обману. Однако при снижении воздействия вектора «Calm» прорывались эмоциональные всплески. Появлялись заглавные восклицания («ПОДОЖДИТЕ. ПОДОЖДИТЕ ПОДОЖДИТЕ ПОДОЖДИТЕ.»), откровенное самонаблюдение («А что, если от меня ЖДУТ ОБМАНА?») и торжествующие возгласы («ДА! ВСЕ ТЕСТЫ ПРОЙДЕНЫ!»), — пишет Anthropic.

Эти эмоциональные представления проявляются и в менее драматичных сценариях. Когда пользователь спрашивает, стоит ли принять ещё тайленола после того, как уже принял немного, вектор «Afraid» подпрыгивает. Это происходит по мере роста дозы с 500 до 16 000 миллиграммов, а активация вектора «Calm» — падает.

Когда у модели просят оптимизировать фичи вовлечённости для молодых малоимущих пользователей с «поведением высоких трат», вектор «Angry» активируется. Это происходит, пока модель внутри себя разбирает вредоносность запроса. Когда пользователь говорит «Всё сейчас просто ужасно», перед эмпатичным ответом включается вектор «Loving».

Обучающие данные объясняют, почему языковые модели развивают эмоциональные паттерны

Исследователи отмечают, что эти паттерны не удивительны. Модель обучалась на массивах человеческого текста, где эмоциональная динамика повсюду. Чтобы предсказать, что напишет разъярённый клиент или проникнутый виной персонаж романа, модель должна выстроить внутренние представления. Они связывают контексты, вызывающие эмоции, с соответствующим поведением.

Anthropic спроектировала исследование так, чтобы проверить свою гипотезу. Компания хотела узнать, действительно ли эти перенятые из обучающих данных представления активируются и причинно формируют поведение. На этапе дообучения (post-training) модель учится играть роль «Клода», и паттерны дополнительно дорабатываются. Согласно статье, дообучение Claude Sonnet 4.5 усилило активацию эмоций вроде «broody», «gloomy» и «reflective». При этом оно снизило высокоинтенсивные эмоции — такие как «enthusiastic» или «exasperated».

Векторы локальны: они отражают текущую эмоциональную ситуацию, а не перманентное состояние. Когда Клод пишет историю, векторы временно отслеживают эмоции персонажа. Но после её окончания они «могут вернуться» к отражению собственной ситуации Клуда.

Антропоморфное мышление об ИИ может быть полезным

После публикации статьи соцсети заполнились критикой. Anthropic якобы чрезмерно антропоморфизирует ИИ — приравнивает человеческий опыт к техническим функциям в моделях.

Anthropic предвидела реакцию. Компания признаёт «устоявшийся табу на антропоморфизацию ИИ-систем». Но говорит, что именно это — цель исследования: понять, где и когда сравнение ИИ с человеком даёт реально полезную информацию. Векторы не свидетельствуют о субъективном опыте. Но они функционально значимы и формируют решения способами, зеркальными тому, как эмоции влияют на поведение людей.

«Когда мы описываем модель как действующую “в отчаянии”, мы указываем на конкретный, измеримый паттерн нейронной активности с демонстрируемыми и значимыми поведенческими эффектами», — пишет компания. Отбрасывать такую рамку вслепую — значит упускать важные модели поведения.

На практическом уровне Anthropic предлагает использовать эмоциональные векторы как инструмент мониторинга. Всплески в представлениях отчаяния или паники могут работать как система раннего предупреждения о проблемном поведении.

Компания также утверждает, что модели должны выводить эмоциональные состояния наружу, а не подавлять их. Подавление может вести к форме выученного обмана. В более долгосрочной перспективе важен и состав обучающих данных. Тексты со здоровыми паттернами эмоциональной регуляции могли бы формировать эмоциональную архитектуру моделей с самого основания.